[實作筆記] 在Pytorch框架下以YOLOv4訓練自定義資料集

0.前言

站在眾多前輩(巨人)的肩膀上看世界。本篇文章主要是分享如何進行YOLOv4模型的訓練資料標記,以及如何在 Pytorch 架構下利用YOLOv4-tiny的模型進行自定義資料集訓練。

1.訓練資料標記

YOLOv4是常見的物件辨識模型之一,為了讓模型能有效學習,必須對訓練資料進行標記,也就是告訴模型,模型需要辨識的物件是什麼,以及該物件位於圖片中的哪個位置。

本文將以Labelimg進行說明。其步驟如下:

1.1.安裝與啟動圖片標記工具Labelimg

在指定虛擬環境中輸入指令 pip install labelimg 。若您尚未建立指定虛擬環境,可參考< Pytorch (Windows) 環境建置 與 YOLOv4 起手式實作 >。

安裝完畢後,在指定虛擬環境中輸入指令 labelimg ,啟動Labelimg。如下圖所示。

1.2.進行圖片標記

source : Kaggle戴口罩的資料集

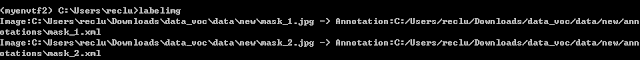

每張圖片標記後會存成XML檔。

2.在Pytorch框架下以YOLOv4訓練自定義資料集

站在巨人的肩膀上看世界,本例使用此作者 bubbliiiing 的Github 進行自定義資料訓練。步驟如下:

2.1. 下載YOLOv4範例程式與預訓練模型權重檔

請在指定虛擬環境中輸入指令 git clone https://github.com/bubbliiiing/yolov4-tiny-pytorch.git

請至原作者github下載pretrained model ( yolov4_tiny_weights_coco.pth ),放在model_data的資料夾中。

source:Greatway99992.2. 自定義資料處理

本例YOLOv4模型指接受的訓練資料為jpg的圖片格式,因此輸入圖片如果尾碼非jpg,需要自己批量轉成jpg後再開始訓練。

假設您已經把自定義的資料都標註好了。本例使用的資料集為Kaggle戴口罩的資料集,如果還沒準備好資料,可至Kaggle下載。該資料集總共有852張圖片包含XML標記檔,可節省您準備資料的時間,幫助您有多餘的心力來學習如何實現用YOLOv4進行自定義資料集訓練。

本文使用VOC格式進行訓練,請將準備好的資料將標記好的文件放在VOCdevkit資料夾中。訓練前將圖片檔放在VOCdevkit資料夾下的VOC2007資料夾下的JPEGImages中。

2.3.訓練前的參數調整

由於是自定義資料集,因此類別等資訊都和原作者所提供的內容不同,所以要進行相關參數調整。

在完成資料集的擺放之後,我們需要對資料集進行下一步的處理,目的是獲得訓練用的2007_train.txt以及2007_val.txt,需要用到根目錄下的 voc_annotation.py。

voc_annotation.py裡面有一些參數需要設置。分別是annotation_mode、classes_path、trainval_percent、train_percent、VOCdevkit_path,第一次訓練可以僅修改classes_path。

在model_data資料夾中,創建 cls_classes.txt 的類別資料,內容為自定義資料夾類別,本例為 "with_mask" 和 "without_mask"。

source:Greatway9999接著以下3份文件檔均需設定 cls_classes.txt 之路徑:

- voc_annotation.py (如下圖所示)

- train.py

- yolo.py

執行 voc_annotation.py,生成了2007_train.txt以及2007_val.txt。此時可以開始訓練了。輸入指令 python voc_annotation.py

source:Greatway99992.4. 訓練

可依據需求調整 train.py 中的Optimizer、Epoch。此例維持原作者預設參數。

確認無誤後,輸入指令 python train.py

接著就是等待模型訓練完畢。以筆者的電腦環境,訓練時間約3個多小時。

2.5. 結果預測

訓練完的權重檔會存放在 log/ 資料夾中,請開啟 yolo.py ,並在"model_path"處更新為最新的權重檔的路徑。

接著輸入指令 python predict.py ,即可進行測試。

測試結果如下圖所示。

<source : Kaggle戴口罩的資料集>

-本文結束-

---

參考資料

- LabelImg 影像標註工具使用教學,製作深度學習用的資料集

- 如何轉換為Yolo txt格式

- Github:bubbliiiing/yolov4-tiny-pytorch

- Github:bubbliiiing/yolov4-pytorch

- PyTorch Yolov4配置

- 深度學習-物件偵測YOLO cfg檔解讀 (三) - 2021年

- bubbliiiing/yolov5-v6.1-pytorch

- 睿智的目标检测30——Pytorch搭建YoloV4目标检测平台

- [機器學習 ML NOTE]YOLO!!!如何簡單使用YOLO訓練出自己的物件偵測!!! (Windows+Anaconda)

- 【YOLOv4-pytorch】训练自己的数据集实践记录及问题总结

- Kaggle戴口罩的資料集

![[PLC基礎程式實作筆記] 快速理解自保持狀態 & 程式實作](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEjp5L53TvWtTUbakp9zbSS96WyhIQqdGRo9aYZNgc_kJ2U56kw-NNzgkNmKunFi7tS9XQDX7miUsmxvhaOkl56pUR7YsvlSJPwVxYRILiyYrnLT8YQgc3pSkfuc81yC4QwzZv-CV4MM7CcU/w180/%25E8%2587%25AA%25E4%25BF%259D%25E6%258C%2581.PNG)

![[除錯救星] Code::Blocks >> can't find compiler executable in your configured search path's for gnu gcc compiler](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEilxbKOd7yAz3lyOBpMI3jgwZPOkXhtC8xsE_lCc1F0zy3ByRvfrRHR29hacD1LKRNwohxXDty0_aqtdjMQqfpTm1rGNNs-PsOzRVO9gh-2jbE0FwXRjBqVm9sYuevUPX4bVtBxlggJA2z9/w180/error.PNG)

![[ LabVIEW for Arduino ] 6 個步驟,輕鬆完成LabVIEW for Arduino的環境建置](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEjtMcc0F0liYVKhv18wsRi9LDRkwEb8GT_TodHixFZaLVKpFtZJz2K6sF4FwQugWfrLx-kKp7lZ8Xe2jQJTnR5iKY1Ek7XgEYoiCNkt9ghXtJEf0FqABo0Nkeu5aQWnle5lhy30u4ZDvAAp/w180/harrison-broadbent-fZB51omnY_Y-unsplash.jpg)

![[ROS SLAM系列] ROS Melodic中的ORB SLAM2環境建置 與 Stereo SLAM實現](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEilMu37F7nOmxEaj6s9GC6iq224_heJEzcO7Z3eF6I1F7wcymoDT_kSNgEr820lrnI2PQ0LmRgF7ywZvEQlu1SrE4OODGvrTVBhdt7hldKIMeYt4kCvMGnRzeZF8sPpQq56fmVreidJyPs4/w180/23.PNG)

![[OpenCV筆記] 12. 傅立葉轉換實作](https://blogger.googleusercontent.com/img/a/AVvXsEhGtpZu-ujaPIotGxwEygKsrWYP4-s0g-9E3sgef1SZg9X4YdXBK0LIOrFA3usC0jrNbIPGHLr59fTC3DYgTjZZ1xb2XirqydrTWbuou_PfrrxeX4hnZAw8LSiVyCmeT0nVnKiiG_iat_Vt1c18CXY-swzQs6VyOVj0I5bUgL1546G6P2zkItLOfOQDiw=w180)

![[LabVIEW程式技巧] 整合練習 : 口罩販賣機軟體設計](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEhyhoWfBATSpHetTVdhWTksg3LKJoKtBaA-N9BvrQs8tBo1Q-U7OqZJUV_XvnMlm-qg8v4DDSd0ItZnqs0lKeRBxHHZ8jfKuQzZtQNasziY3B9oPKE-7rJ0Tuxc69ZEgqZ2wW4r5Z4LsUyK/w180/frontpanel.PNG)

![[matlab練習] 實作離散系統之單位步階響應 (差分方程與轉移函數)](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEh793ICAgWLoYehhlcbBRSw9oeK3UbxbuUw-8Re5zxKaMGi91jQPXIHnv2QEYGdVh9Oiq-Ci3enPgcp2d8ym-s90u-p6U8opC548ZyOLDPTxMD58b3fEvCI17yMFt0-WozpcSBr29ww3V56/w180/1.PNG)

![[LabVIEW程式技巧] 整合練習 : ATM軟體設計](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEhvarRAErh18czdczz_LQZYqgBk4udif5gXWdXSfbJ-upfFMiD2_18AKpAqZKG-4S3c_w8PePKMXWa6oLQbgZVXC01B39BNL4ULVH6xmUmhupytBUCMmffbHCD0H-UJ4QK2FWcYf96GPv9X/w180/atm2.PNG)

0 留言